Компания Penguin Solutions объявила о выпуске первого в отрасли готового к промышленному применению сервера KV-кэша, использующего технологию CXL для решения одной из ключевых проблем современных AI-систем — ограничения пропускной способности и объёма памяти, известного как «memory wall». Новая система получила название MemoryAI KV cache server и ориентирована на ускорение инференса в корпоративных и агентных AI-сценариях.

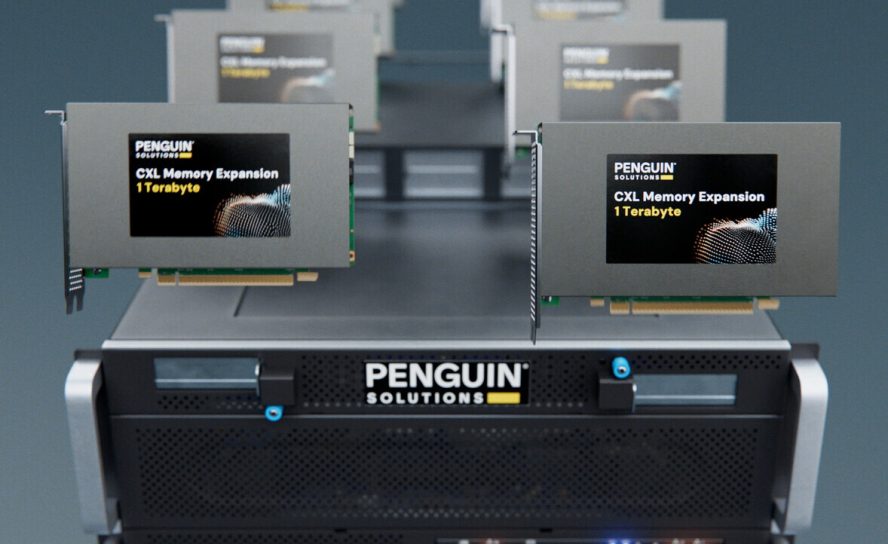

В отличие от обучения моделей, которое преимущественно ограничено вычислительными ресурсами, инференс в реальном времени зависит в первую очередь от памяти и задержек. По оценкам компании, до 70% таких нагрузок определяется именно характеристиками памяти, что приводит к простою GPU и снижению эффективности кластеров. Новый сервер решает эту проблему за счёт значительного увеличения доступного объёма памяти: система сочетает до 3 ТБ DDR5 и до 8 карт расширения CXL по 1 ТБ каждая, доводя суммарный объём до 11 ТБ.

Использование CXL-памяти позволяет создать дополнительный уровень в иерархии памяти, дополняющий HBM и традиционную DRAM, и обеспечивающий существенно более быстрый доступ к данным по сравнению с NVMe-накопителями. Это критично для задач с большими контекстными окнами, включая генерацию с дополнением извлечением (RAG), анализ финансовых данных и обработку регуляторной информации в реальном времени. Расширенная память также снижает необходимость повторных вычислений, повышает загрузку GPU и ускоряет обработку данных.

Сервер совместим с архитектурой NVIDIA Dynamo от NVIDIA, что упрощает интеграцию в существующие AI-инфраструктуры и позволяет эффективно выгружать KV-кэш из GPU-памяти. Это даёт возможность гибко масштабировать кластеры, оптимизируя баланс между вычислительными и память-ориентированными ресурсами.

По словам технического директора Penguin Solutions Фила Покорны, внедрение CXL-ориентированных решений позволяет существенно сократить время до получения первого токена, ускорить генерацию ответов и увеличить общую пропускную способность систем. При этом достигается не только рост производительности, но и повышение энергоэффективности по сравнению с традиционными GPU-серверами с эквивалентной конфигурацией.

MemoryAI KV cache server уже используется рядом клиентов для оптимизации производительности AI-кластеров и обеспечения стабильного соблюдения SLA в условиях растущих требований к моделям, объёму контекста и параллелизму вычислений. Решение будет продемонстрировано на конференции NVIDIA GTC 2026, где компания представит его как один из ключевых элементов инфраструктуры для масштабируемого AI-инференса.