На выставке CES NVIDIA показала, как развитие открытых ИИ-моделей и новая архитектура Grace Blackwell радикально меняют саму философию разработки искусственного интеллекта. Компания представила DGX Spark и DGX Station — настольные ИИ-суперкомпьютеры, которые позволяют запускать и дорабатывать современные модели прямо на рабочем месте, без необходимости обращаться к облачным дата-центрам. По замыслу NVIDIA, это должно сократить путь от идеи до работающего ИИ-продукта и дать разработчикам больше контроля над данными и кодом.

DGX Spark ориентирован на широкий круг разработчиков, исследователей и дата-сайентистов. Он рассчитан на работу с моделями вплоть до 100 миллиардов параметров и поставляется уже настроенным с программной экосистемой NVIDIA, включая AI-инструменты и библиотеки CUDA-X. Такой подход превращает систему в готовый «песочницу» для экспериментов, тонкой настройки и инференса. Более мощный DGX Station адресован компаниям и исследовательским лабораториям и способен локально работать с моделями масштаба до одного триллиона параметров — уровень, который ещё недавно был доступен исключительно крупным дата-центрам.

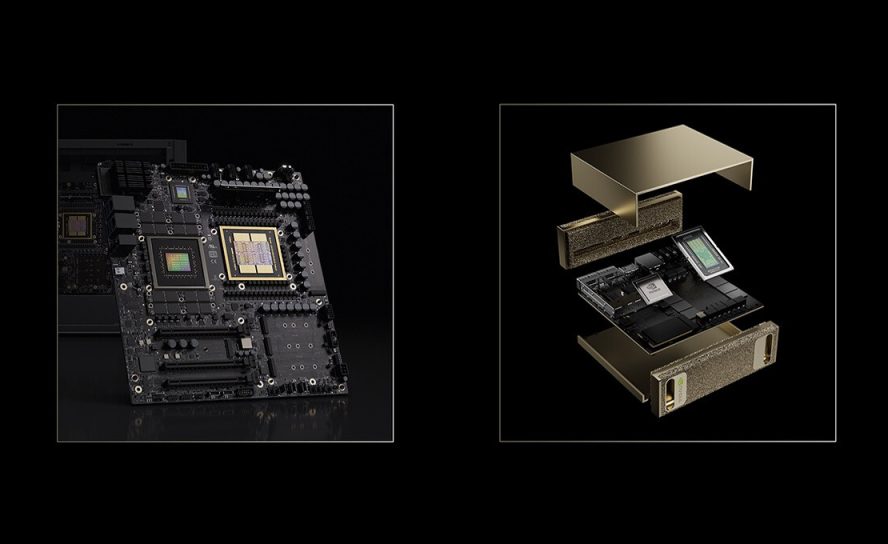

Обе системы построены на архитектуре Grace Blackwell и оснащены большим единым пулом памяти и производительностью на уровне петафлопс. Это позволяет разрабатывать и тестировать ИИ локально, а затем безболезненно масштабироваться в облако или корпоративную инфраструктуру. Важную роль здесь играет формат NVFP4, появившийся в архитектуре Blackwell: он позволяет сжимать модели до 70 процентов без потери качества, ускоряя работу и снижая требования к памяти.

NVIDIA подчёркивает, что ключевым фактором стала работа с open-source-сообществом. Благодаря оптимизациям и сотрудничеству с проектами вроде llama.cpp производительность запуска современных моделей на DGX Spark в среднем выросла примерно на треть, а время загрузки больших языковых моделей заметно сократилось. Это делает локальную разработку не просто возможной, а по-настоящему удобной.

DGX Station выделяется особенно. Оснащённый суперчипом GB300 Grace Blackwell Ultra и почти 800 ГБ согласованной памяти, он открывает доступ к работе с передовыми моделями вроде Qwen, Llama, Mistral и DeepSeek прямо с рабочего стола. Разработчики инфраструктурных фреймворков и системных библиотек уже называют появление DGX Station переломным моментом, поскольку теперь тестирование и оптимизация под столь мощное «железо» больше не требуют доступа к дорогостоящим стойкам в дата-центрах.

На стенде NVIDIA в рамках CES компания демонстрирует реальные сценарии использования новых систем — от высокоскоростного предобучения языковых моделей до визуализации массивных наборов данных и построения графов знаний. Отдельный акцент сделан на креативных задачах. Современные модели генерации изображений и видео получили поддержку NVFP4 и NVFP8, что позволяет ускорять рендеринг и снижать нагрузку на память. В живых демонстрациях DGX Spark берёт на себя тяжёлые задачи видеогенерации, обеспечивая кратный прирост скорости по сравнению с топовыми ноутбуками и освобождая рабочие машины для творчества без задержек.

Новые системы находят применение и за пределами классической разработки. NVIDIA показывает, как DGX Spark может выступать «мозгом» для ИИ-агентов и робототехники, включая интерактивных роботов и даже экспериментальные городские транспортные средства. Такой локальный ИИ позволяет работать с чувствительными данными без отправки их в облако и открывает дорогу к более интерактивным и автономным сценариям.

В компании считают, что рост интереса к локальному ИИ — это ответ на запросы рынка в области безопасности, контроля интеллектуальной собственности и скорости итераций. DGX Spark и DGX Station становятся частью этого сдвига, предлагая разработчикам и компаниям мощность дата-центра в форм-факторе рабочей станции. Системы уже доступны через партнёров NVIDIA, а выход DGX Station запланирован на текущий год, что, по всей видимости, станет новым этапом в эволюции настольных ИИ-платформ.