Платформа NVIDIA Blackwell, уже широко используемая крупными провайдерами инференса, получила развитие в виде Blackwell Ultra и нацелена на новый этап эволюции агентного ИИ. По данным отчёта OpenRouter State of Inference, за последний год доля запросов, связанных с программированием и автоматизированной разработкой кода, выросла с 11% почти до 50%. Такие нагрузки требуют не только высокой пропускной способности, но и минимальной задержки, особенно при работе с длинным контекстом и многошаговыми цепочками рассуждений.

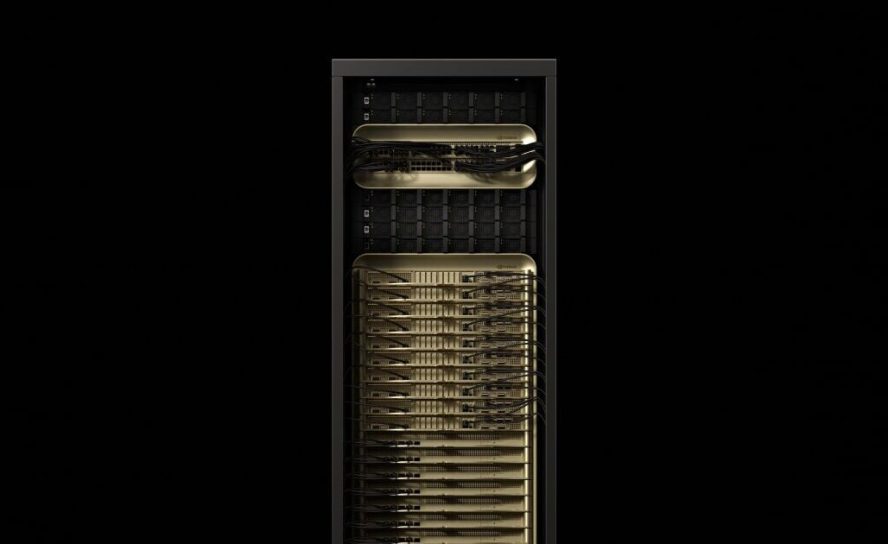

Новые данные SemiAnalysis InferenceX показывают, что сочетание глубокой оптимизации программного стека и аппаратных возможностей Blackwell Ultra даёт резкий скачок эффективности. Системы NVIDIA GB300 NVL72 демонстрируют до 50 раз более высокую производительность на мегаватт по сравнению с платформой Hopper, что в реальных сценариях приводит к снижению стоимости обработки токенов до 35 раз. Такой результат достигнут за счёт комплексного подхода к проектированию — от архитектуры чипов и системного уровня до библиотек и инструментов инференса.

Ранее исследования Signal65 уже фиксировали, что GB200 NVL72 обеспечивала более чем десятикратный прирост токенов на ватт относительно Hopper. Однако Blackwell Ultra развивает этот эффект, особенно в задачах с низкой задержкой, где работают агентные ИИ-приложения и интерактивные помощники для программирования. Постоянные улучшения в NVIDIA TensorRT-LLM, Dynamo, Mooncake и SGLang позволяют существенно повышать пропускную способность при инференсе моделей с архитектурой mixture-of-experts, а оптимизированные GPU-ядра, NVLink Symmetric Memory и более эффективное управление запуском вычислений минимизируют простои и задержки.

Наиболее заметное преимущество GB300 NVL72 проявляется при работе с длинным контекстом. В сценариях, где модель обрабатывает входы объёмом до 128 тысяч токенов и формирует длинные ответы, система обеспечивает до полуторакратного снижения стоимости токена по сравнению с GB200. Это стало возможным благодаря более высокой вычислительной производительности в формате NVFP4 и ускоренной обработке механизма внимания, что критично для анализа крупных кодовых баз целиком.

Инфраструктура на базе GB300 NVL72 уже внедряется в промышленную эксплуатацию. Такие компании, как Microsoft, CoreWeave и Oracle Cloud Infrastructure, используют эти системы для задач агентного программирования и интерактивных ассистентов, где каждая миллисекунда задержки напрямую влияет на пользовательский опыт и совокупную стоимость вычислений.

В NVIDIA подчёркивают, что по мере смещения фокуса индустрии в сторону инференса эффективность работы с длинным контекстом и экономика токенов становятся ключевыми факторами. При этом компания уже смотрит дальше: следующая платформа Vera Rubin NVL72 должна обеспечить ещё один скачок производительности, предлагая до десятикратного прироста пропускной способности на мегаватт по сравнению с Blackwell и позволяя обучать крупные модели MoE с существенно меньшим числом GPU.