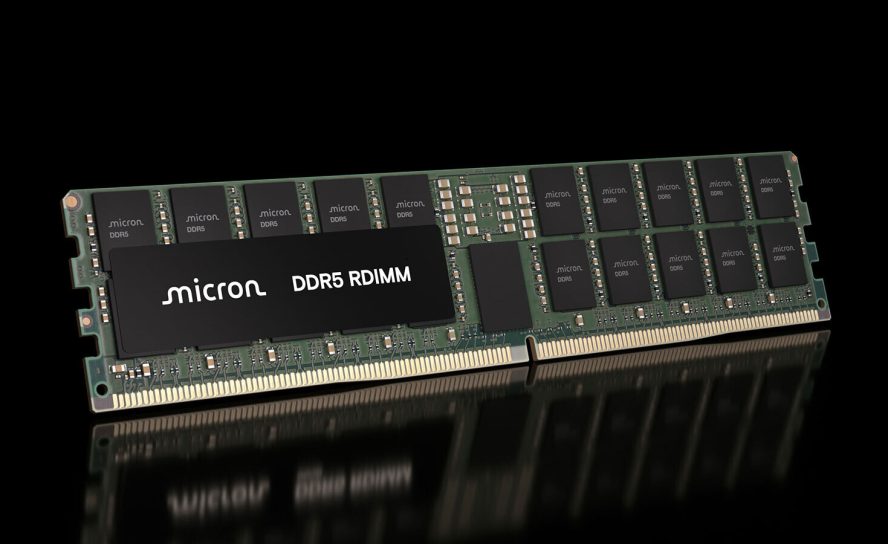

Компания Micron Technology объявила о начале поставок тестовых образцов новых модулей DDR5 RDIMM объёмом 256 ГБ для производителей серверных платформ и крупных партнёров экосистемы дата-центров. Новинка ориентирована прежде всего на инфраструктуру искусственного интеллекта, где требования к объёму памяти растут уже быстрее, чем производительность самих процессоров.

Новые модули построены на памяти Micron поколения 1-gamma — одном из самых современных DRAM-техпроцессов компании. Заявленная скорость достигает 9200 MT/s, что более чем на 40% выше по сравнению с большинством массовых серверных DDR5-модулей, используемых сегодня в дата-центрах.

Но главная особенность решения — не только скорость. Micron делает ставку на сочетание огромного объёма памяти, высокой пропускной способности и энергоэффективности, которые становятся критически важными в эпоху искусственного интеллекта.

Современные большие языковые модели и AI-системы требуют колоссальных объёмов оперативной памяти. Для работы нейросетей с десятками триллионов параметров серверы уже используют сотни гигабайт, а иногда и терабайты DRAM на один вычислительный узел. И если раньше главным ограничением были GPU, то сегодня всё чаще именно память становится «узким местом» AI-инфраструктуры.

Micron пытается решить эту проблему сразу несколькими технологиями. Новый RDIMM использует продвинутую упаковку с 3D-стекингом кристаллов памяти и TSV-соединениями — вертикальными каналами внутри кремния, позволяющими объединять несколько слоёв DRAM в единую высокоскоростную структуру.

Фактически компания переносит идеи, которые раньше ассоциировались в основном с HBM-памятью для AI-ускорителей, в более традиционный сегмент серверной DDR5.

Особенно важным выглядит снижение энергопотребления. По данным Micron, один модуль объёмом 256 ГБ способен потреблять более чем на 40% меньше энергии по сравнению с двумя модулями по 128 ГБ. Для современных дата-центров это критически важно: рост AI-инфраструктуры уже упирается не только в стоимость оборудования, но и в лимиты по питанию и охлаждению.

На практике новые модули позволяют увеличить объём памяти на один процессорный сокет без выхода за тепловые и энергетические ограничения серверов. Это особенно важно для гиперскейлеров и операторов AI-дата-центров, которые сегодня вынуждены балансировать между производительностью, плотностью размещения оборудования и расходами на электроэнергию.

Старший вице-президент Micron Радж Нарасимхан заявил, что именно объём памяти, пропускная способность и энергопотребление становятся ключевыми факторами эффективности AI-систем нового поколения.

Компания уже начала совместную валидацию модулей с производителями серверных платформ. Это должно ускорить внедрение памяти в коммерческие решения для AI и HPC-сегмента.

Появление подобных модулей хорошо показывает, как быстро меняется рынок серверной памяти под влиянием искусственного интеллекта. Если раньше рост объёма DRAM происходил относительно постепенно, то сегодня индустрия фактически вынуждена ускоряться из-за взрывного увеличения размеров AI-моделей и нагрузки на инфраструктуру.

На фоне глобального дефицита памяти и рекордного спроса со стороны AI-рынка новые решения Micron могут стать одним из ключевых элементов следующего поколения дата-центров, где борьба идёт уже не только за вычислительную мощность, но и за каждый дополнительный гигабайт оперативной памяти.