Компания Meta Platforms раскрыла амбициозную дорожную карту развития собственных ускорителей искусственного интеллекта Meta Training and Inference Accelerator (MTIA), сделав основной акцент на повышении эффективности инференса — этапа применения уже обученных моделей. В ближайшие два года компания планирует внедрить сразу четыре поколения чипов MTIA в свои дата-центры. Новая линейка включает решения MTIA 300, 400, 450 и 500, разработанные в сотрудничестве с Broadcom.

Ранние версии ускорителей уже используются в инфраструктуре Meta для обработки задач ранжирования и рекомендаций контента, тогда как более поздние поколения ориентированы на обслуживание моделей в режиме реального времени. Для компании, управляющей одними из крупнейших социальных платформ в интернете, высокая скорость инференса имеет критическое значение: алгоритмы рекомендаций должны работать практически мгновенно, обеспечивая плавный пользовательский опыт при просмотре ленты и взаимодействии с контентом.

В отличие от многих производителей ускорителей, которые делают ставку на максимальную вычислительную производительность, Meta уделяет особое внимание пропускной способности и объему памяти. В архитектуре MTIA именно эти параметры растут наиболее заметно от поколения к поколению, тогда как вычислительная мощность увеличивается более плавно. Такой подход направлен на повышение эффективности обработки запросов в реальных рабочих нагрузках, поскольку увеличение пропускной способности памяти снижает задержки и позволяет уменьшить энергопотребление при массовом выполнении инференса.

Новые чипы также получили аппаратную поддержку ключевых элементов современных нейросетевых архитектур, включая механизмы внимания и слои типа mixture-of-experts. Кроме того, архитектура предусматривает использование форматов пониженной точности, оптимизированных именно для инференса, что позволяет уменьшить накладные расходы на преобразование данных и повысить общую эффективность вычислений.

Важным элементом стратегии стала совместимость программного обеспечения. В Meta заявляют, что программная экосистема MTIA работает с распространенными фреймворками машинного обучения, благодаря чему существующие модели можно запускать как на GPU, так и на новых ускорителях без значительных изменений кода. Такой подход должен облегчить интеграцию новых чипов в производственную инфраструктуру.

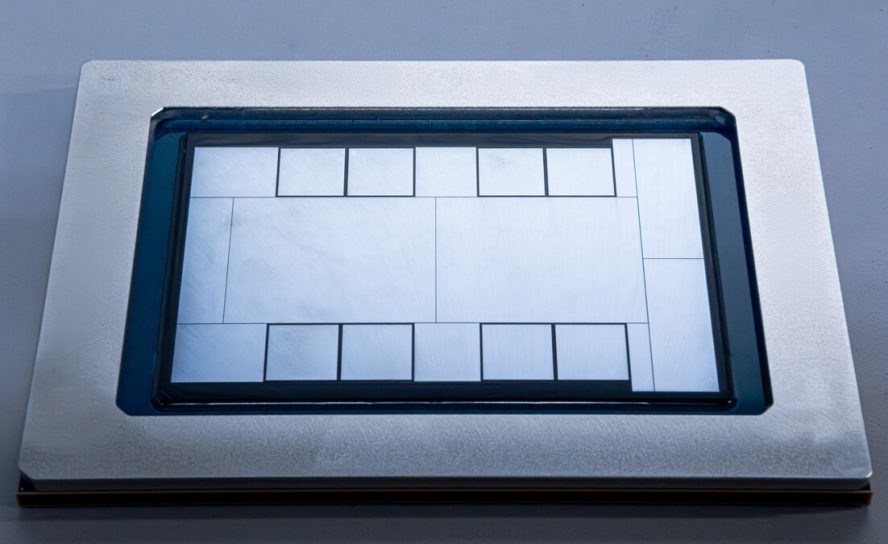

Еще одной особенностью платформы стала модульная архитектура серверов. Несколько поколений MTIA разрабатываются с учетом использования одинаковых стоек, корпусов и сетевой инфраструктуры. Это позволяет обновлять вычислительные мощности путем замены модулей, не модернизируя полностью серверные системы дата-центров. Подобная стратегия объясняет высокую скорость обновления архитектуры ускорителей, особенно с учетом того, что инфраструктура Meta насчитывает миллионы вычислительных чипов.

Современные версии MTIA уже работают с энергопотреблением на уровне киловатт и обеспечивают вычислительную производительность в диапазоне петафлопс, что выводит их в прямую конкуренцию с решениями ведущих производителей ускорителей, включая NVIDIA и Advanced Micro Devices.

Разработка собственных ASIC-ускорителей становится все более распространенной практикой среди крупных облачных провайдеров. Однако в случае Meta этот шаг особенно оправдан, поскольку основная нагрузка на инфраструктуру приходится именно на инференс: модели обучаются относительно редко, тогда как их использование в рекомендационных системах происходит непрерывно и в огромных масштабах.

Дополнительный интерес к проекту вызывает тот факт, что Meta активно участвует в деятельности Open Compute Project и часто публикует открытые спецификации серверных платформ. Это означает, что некоторые инженерные решения, разработанные для MTIA и соответствующей серверной инфраструктуры, в перспективе могут найти применение и в других системах для дата-центров.