Мир искусственного интеллекта развивается семимильными шагами, и вместе с ним растут требования к «железу», которое эти прорывы обеспечивает. Особенно остро стоит вопрос памяти: традиционные решения порой не справляются с огромными объемами данных, необходимыми для обучения и работы сложных нейросетей. В этом контексте NVIDIA, безусловный лидер в области ИИ-ускорений, на прошлой неделе раскрыла амбициозный план: компания собирается развернуть от 600 000 до 800 000 модулей памяти SOCAMM уже в 2025 году. Этот шаг может кардинально изменить ландшафт рынка памяти, поставив технологию SOCAMM в позицию прямого конкурента, а возможно, и преемника современных решений High-Bandwidth Memory (HBM).

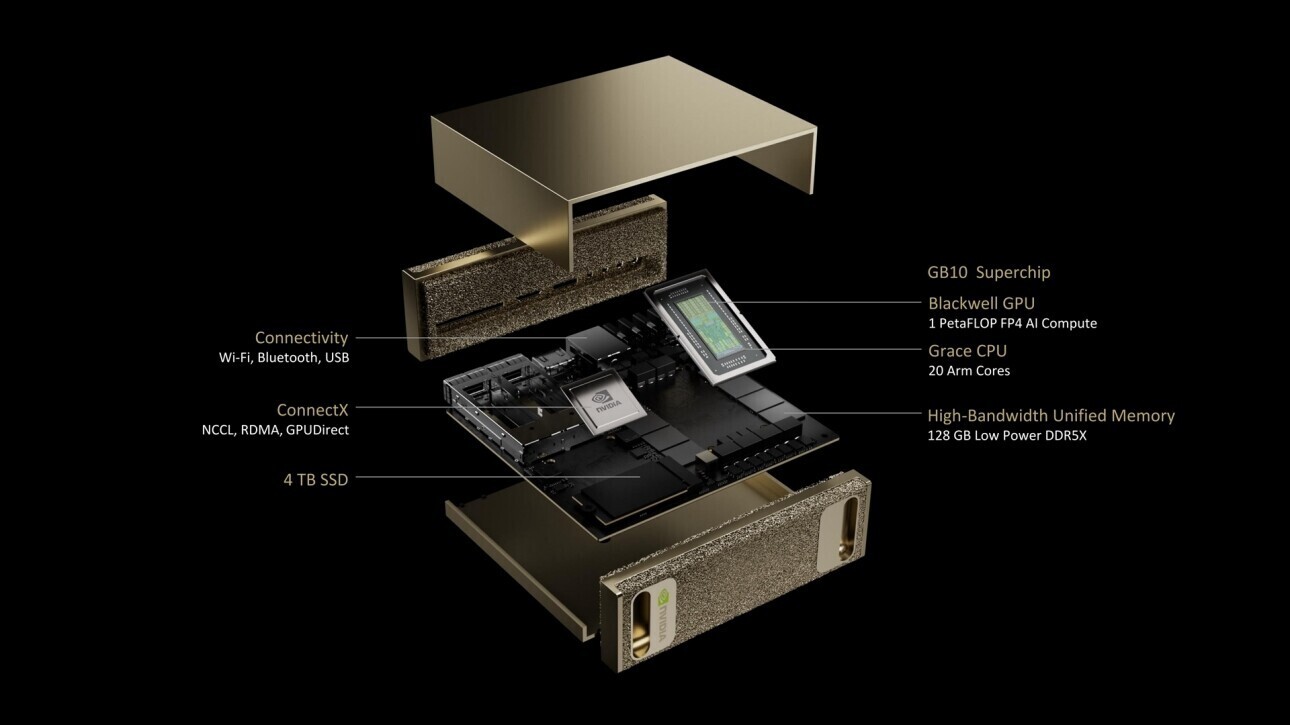

NVIDIA планирует интегрировать эти модули в свои грядущие ИИ-продукты, такие как мощнейшая платформа GB200/GB300 «Blackwell» и система AI PC Digits, которые были представлены на конференции GTC 2025. Сообщается, что NVIDIA уже донесла свои прогнозы по объемам заказов до ключевых поставщиков памяти и подложек. Компания вела совместную разработку SOCAMM с тремя гигантами рынка памяти: Samsung Electronics, SK Hynix и Micron Technology. Однако, как сообщают Digitimes Asia со ссылкой на ET News и Wccftech, именно Micron удалось получить одобрение на серийное производство раньше своих конкурентов. Это дает Micron значительное преимущество в этой новой, перспективной нише.

Что такое SOCAMM и почему это важно?

SOCAMM (System on Chip Advanced Memory Module) — это не просто новый тип памяти, это технологический прорыв, использующий LPDDR DRAM для повышения производительности в задачах ИИ, требующих высокой пропускной способности при низком энергопотреблении. Micron утверждает, что SOCAMM обеспечивает в 2,5 раза большую пропускную способность, при этом сокращая размер и энергопотребление на треть по сравнению со стандартными серверными модулями RDIMM.

Это критически важно для ИИ-вычислений, где каждый ватт энергии и каждый миллиметр пространства на плате имеют значение. Чем эффективнее память, тем более мощные и компактные системы можно создавать, будь то серверы в дата-центрах или персональные компьютеры с ИИ-ускорителями.

Хотя запланированное развертывание SOCAMM (600-800 тысяч модулей) пока меньше, чем ожидаемые 9 миллионов единиц HBM, которые NVIDIA планирует закупить в 2025 году, этот шаг знаменует ключевой сдвиг на рынке. Отраслевые эксперты видят в этом потенциального «переломщика» правил игры для сегментов памяти и подложек. Массовое внедрение SOCAMM показывает уверенность NVIDIA в этой технологии.

От серверов к домашним ПК: где мы увидим SOCAMM?

Развертывание SOCAMM охватит как корпоративный, так и потребительский рынки. Первоначально технология будет нацелена на ИИ-серверы и рабочие станции, где требуется максимальная производительность для самых сложных вычислений. Однако в дальнейшем планируется ее интеграция и в персональные компьютеры.

Это означает, что в будущем SOCAMM может стать стандартом для «AI PC» — нового поколения компьютеров, где локальная обработка ИИ-задач будет столь же важна, как и традиционные вычисления. Для геймеров это может означать еще более быстрые загрузки и более сложную внутриигровую физику, управляемую ИИ. Для профессионалов, работающих с графикой, видео или научными расчетами, SOCAMM обещает значительное ускорение рабочих процессов.

Технология SOCAMM сочетает в себе экономически эффективный рост с потребностями высокопроизводительных ИИ-нагрузок. Это означает, что NVIDIA не просто ищет «самую быструю» память, но и ту, которая может быть масштабирована и внедрена массово, не взвинчивая при этом стоимость конечных продуктов до небес.

Micron впереди: кто выиграет от этой гонки?

Тот факт, что Micron Technology получила одобрение на серийное производство SOCAMM раньше Samsung и SK Hynix, является значительной победой для компании. Это не только укрепляет ее позиции как ключевого партнера NVIDIA, но и открывает двери к огромным объемам заказов в будущем. В условиях жесткой конкуренции на рынке памяти, ранняя готовность к производству новой, востребованной технологии дает огромное преимущество.

В конечном итоге, эта новость важна для всех:

Для энтузиастов и пользователей ПК: SOCAMM обещает более мощные и энергоэффективные ИИ-вычисления непосредственно на вашем компьютере. Это может привести к появлению новых функций, ускорению работы приложений и открытию ранее недоступных возможностей.

Для профессионалов и разработчиков ИИ: Увеличенная пропускная способность и сниженное энергопотребление позволят создавать еще более сложные и эффективные модели ИИ, сокращая время на обучение и развертывание.

Для индустрии в целом: Масштабное внедрение SOCAMM может спровоцировать цепную реакцию, стимулируя дальнейшие инновации в разработке памяти и ускоряя переход к более совершенным ИИ-решениям.

Развертывание SOCAMM — это не просто очередной анонс NVIDIA. Это сигнал о том, что будущее высокопроизводительных вычислений и искусственного интеллекта будет тесно связано с новыми, более эффективными архитектурами памяти. И Micron, похоже, занимает лидирующие позиции в этой захватывающей гонке. Ждем первых продуктов на базе SOCAMM, чтобы оценить их потенциал в реальных условиях!