Китайская компания DeepSeek, всколыхнувшая мир искусственного интеллекта своей моделью R1, готовит к выпуску значительно усовершенствованную версию DeepSeek R2. Согласно данным инсайдера @iruletheworldmo, новая система демонстрирует впечатляющие технические характеристики и рекордную эффективность.

Технологический прорыв:

- Вычислительная мощность: 512 PetaFLOPS (FP16) при 82% загрузке кластеров

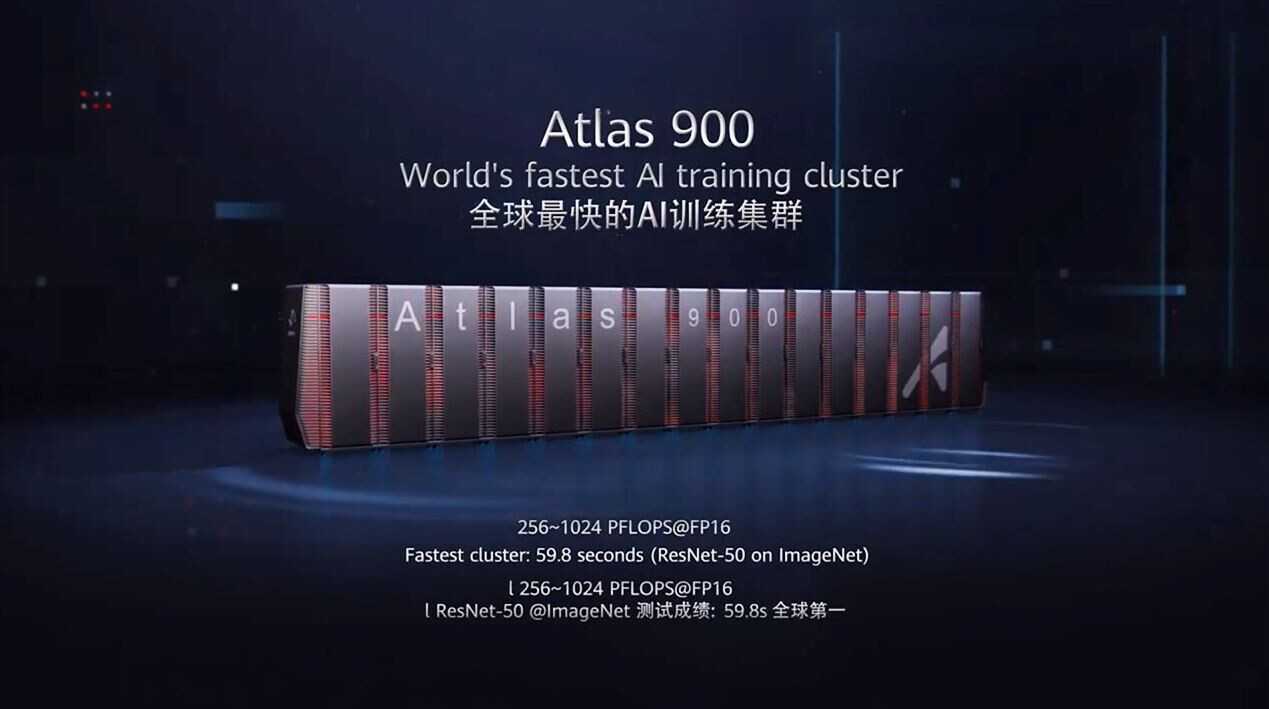

- Аппаратная основа: чипы Huawei Ascend 910B и возможная система Huawei Atlas 900

- Энергоэффективность: на 97,3% снижена стоимость обучения по сравнению с аналогами

- Производительность: достигает 91% от показателей кластеров NVIDIA A100

Инфраструктурные решения:

Компания создала мощную экосистему с ведущими китайскими производителями:

- Tuowei Information отвечает за более половины заказов суперкомпьютерного оборудования

- Sugon поставляет серверные стойки с жидкостным охлаждением (до 40 кВт на стойку)

- Innolight обеспечивает 35% экономию энергии благодаря кремний-фотонным трансиверам

География вычислений:

Гибкая распределенная инфраструктура включает:

- Южно-Китайский центр (Runjian Shares) с бюджетом свыше 5 млрд юаней в год

- Северо-Западный резерв (Zhongbei Communications) мощностью 1,500 PetaFLOPS

- Северный узел (Hongbo Shares) добавит еще 3,000 PetaFLOPS

Перспективы развития:

Huawei готово развернуть систему CloudMatrix 384 (384 ускорителя Ascend 910C) как альтернативу NVIDIA GB200 NVL72. Хотя китайское решение уступает в производительности на чип и потребляет больше энергии, оно предлагает значительные преимущества в общей мощности и объеме HBM-памяти.

Ожидается, что официальный анонс DeepSeek R2 и публикация бенчмарков произойдут в ближайшее время, что позволит объективно оценить реальные возможности новой системы.